Le guide de la maman qui n’est pas née de la dernière pluie

“Bon. On m’a encore dit que l’IA, c’est formidable, que les chatbots sont géniaux, que je dois faire confiance. Très bien. Mais moi, j’ai besoin de savoir : ce truc à qui je parle en ligne… c’est un humain ou pas ? Parce que non, je ne vais pas juste ‘faire confiance’. Voilà mon guide.”

Comprendre le problème

D’abord : c’est quoi exactement un chatbot ?

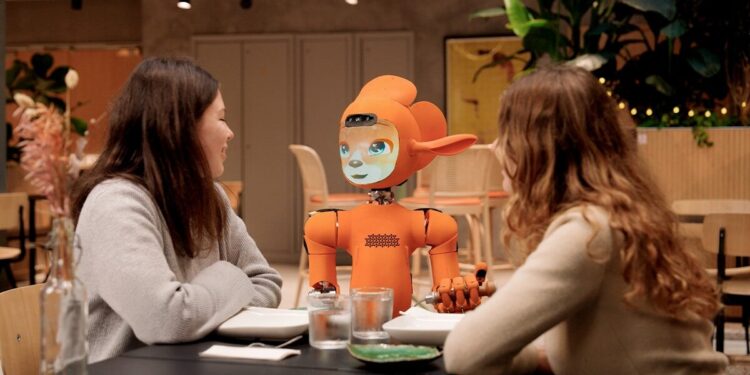

Un chatbot, c’est un programme informatique conçu pour simuler une conversation humaine. Texte, voix, parfois même vidéo. Les plus récents — GPT, Claude, Gemini et compagnie — sont si bien entraînés qu’ils peuvent imiter l’humain de façon bluffante. Et ça, franchement, ça me met hors de moi.

Pourquoi ? Parce qu’on nous demande de les consulter pour tout : du service client à l’aide psychologique, en passant par les plateformes de rencontres. Et la plupart du temps, personne ne nous prévient.

Attention gros risque

Des études ont montré que les utilisateurs sont souvent incapables de distinguer un chatbot d’un humain dans une conversation par écrit — surtout quand le bot est récent et bien conçu. Ce n’est pas de la science-fiction, c’est maintenant.

Repérer les indices

Les signes qui trahissent une machine (mais attention, c’est de plus en plus difficile)

Les chercheurs ont identifié plusieurs marqueurs qui peuvent mettre la puce à l’oreille. Je vous les donne, mais je vous préviens : les IA s’améliorent vite, alors ne baissez pas la garde.

La rapidité de réponse. Un humain prend du temps pour réfléchir, taper, se corriger. Un bot peut répondre en une fraction de seconde à n’importe quelle question, même complexe. Si votre interlocuteur répond instantanément à “Explique-moi la théorie des cordes en 3 phrases”, méfiance.

La régularité du style. Les humains font des fautes, changent de registre, s’énervent, utilisent des expressions régionales ou des abréviations. Un bot a tendance à rester dans un registre très stable, très “propre”, presque trop poli.

L’esquive des questions personnelles. Posez une question très précise, ancrée dans le réel : “T’étais où le week-end dernier ?” ou “C’est quoi ta pointure ?”. Un bot va esquiver ou donner une réponse vague. Un humain va répondre, s’étonner, ou vous demander pourquoi vous demandez ça.

Astuce pratique

Posez des questions absurdes ou hors-sujet, genre : “Si t’étais un légume, ce serait lequel et pourquoi ?” Les bots répondent souvent trop proprement à ce genre de questions. Un humain va rire, être décontenancé, ou répondre avec incohérence — et c’est ça, la vraie vie.

Le test ultime

Posez des questions que seul un humain peut vraiment répondre

Les scientifiques qui travaillent sur ce sujet s’appuient sur un concept vieux de 75 ans : le test de Turing. L’idée : si vous ne pouvez pas distinguer la machine de l’humain, la machine a “réussi” à imiter l’intelligence humaine.

“Le test de Turing ne cherche pas à savoir si une machine pense, mais si elle peut convaincre un humain qu’elle pense.” Alan Turing, “Computing Machinery and Intelligence”, 1950

Sauf que… les chatbots modernes passent ce test. Une étude de 2024 publiée dans PNAS a montré que GPT-4 était identifié comme humain dans 54% des cas. Autrement dit, il trompe la moitié des gens. La moitié !

Alors comment faire mieux ? Les chercheurs suggèrent de s’appuyer sur :

- Les références culturelles très locales (une blague de quartier, une émission régionale)

- Les incohérences émotionnelles (un humain peut se contredire, changer d’avis en cours de conversation)

- Les détails sensoriels spontanés (“j’ai les mains froides là” — un bot ne ressent rien)

Test inutile

Attention : demander directement “Es-tu un robot ?” ne sert souvent à rien. Les chatbots peuvent mentir — ou du moins, ne pas répondre franchement si leur opérateur leur a donné des instructions en ce sens. Oui. Ça existe. Non, ce n’est pas rassurant.

La checklist pratique

Mon protocole AngryMum en 7 points

Avant de faire confiance à votre interlocuteur en ligne…

- ✓Vérifiez la vitesse de réponse : trop rapide = suspect. Utilisez un chronomètre mental.

- ✓Posez une question personnelle et précise : une vraie, ancrée dans le quotidien (“t’as mangé quoi ce midi ?”).

- ✓Introduisez une erreur volontaire dans votre message. Un humain la relèvera ou l’ignorera naturellement. Un bot peut la corriger de façon trop formelle.

- ✓Changez de sujet brutalement, sans transition. Les humains suivent le mouvement. Les bots peuvent galérer.

- ✓Demandez une opinion tranchée sur un sujet sensible (politique, football, télé-réalité). Les bots évitent souvent les prises de position fermes.

- ✓Cherchez le nom de la plateforme et vérifiez si elle annonce utiliser une IA (obligation légale croissante en Europe depuis l’AI Act).

- ✓Faites confiance à votre instinct : si quelque chose sonne faux, trop lisse, trop parfait — c’est souvent que ça l’est.

Le cadre légal

Vos droits : ce que la loi dit (et ce qu’elle ne fait pas encore assez)

Bonne nouvelle : en Europe, l’AI Act entré en vigueur en 2024 impose aux opérateurs de systèmes d’IA de vous informer que vous interagissez avec une intelligence artificielle dès que ce n’est pas évident. C’est un droit. Vous pouvez le réclamer.

Mauvaise nouvelle (vous vous en doutiez) : tout le monde ne joue pas le jeu. Des applications de rencontres, des services client, des “coachs” en ligne utilisent des bots sans le mentionner clairement. Et les sanctions restent encore limitées dans la pratique.

Astuce légale

En France, la CNIL peut recevoir vos signalements si vous pensez qu’une plateforme vous a induit en erreur sur la nature de votre interlocuteur (humain vs IA). Ce n’est pas inutile de le faire — c’est comme ça que les choses bougent.

Le mot de la fin (et je ne mâche pas mes mots)

Non, je ne suis pas contre la technologie. Je suis contre le mensonge par omission. Je suis contre qu’on me parle comme si j’étais idiote, ou que mes enfants se lient d’amitié avec un programme sans le savoir.

La transparence, c’est pas compliqué. C’est juste écrire “vous parlez à une IA” en haut de la conversation. Pas dans les conditions générales à la page 47.

En attendant que les entreprises fassent leur boulot, on s’équipe. On observe. On teste. On pose des questions gênantes. Et on reste méfiantes — mais éclairées.

Sources & références

- Bornet C. & Kaplan F., “Comment savoir si je parle à un chatbot”, The Conversation France, 2025. → Lire l’article original

- Turing A.M., “Computing Machinery and Intelligence”, Mind, vol. 59, n°236, pp. 433–460, 1950.

- Jannai D. et al., “Human or Not? A Gamified Approach to the Turing Test”, arXiv, 2023. → arxiv.org

- Mei J. et al., “Turing Test : GPT-4 passes in a study with human judges”, PNAS, 2024. Étude citée dans The Conversation (op. cit.) — GPT-4 perçu comme humain dans 54 % des interactions.

- Règlement européen sur l’intelligence artificielle (AI Act), Règlement (UE) 2024/1689, entré en vigueur le 1er août 2024. → Texte officiel EUR-Lex

- CNIL (Commission nationale de l’informatique et des libertés), ressources sur l’IA et les droits des utilisateurs. → cnil.fr